企業のオンプレミス環境にデプロイしてもIPを失わない

企業の機密データの多くはオンプレミスに存在し、データ主権やコンプライアンス法によって保護されています。一方でフロンティアAIモデルはクラウド上にあります。結果として、最高のAIが動く場所と最も重要なデータが存在する場所のあいだに大きな溝が生まれています。双方ともこの溝を埋めたいと考えています。企業は、決して外部へ晒せないデータを活用し、推論レイテンシも最小化するために、自社インフラ上でフロンティアモデルを動かす必要があります。AIラボはエンタープライズ収益を求めていますが、何年にもわたる研究と数百万ドルの投資の結晶であるモデルの重みを犠牲にはしたくありません。

障壁は推論です。モデルを実行すると、その重みは平文のままGPUメモリに読み込まれ、完全に露出します。従来のセキュリティは保存時と転送時のデータを保護しますが、最も重要な瞬間――使用中、すなわち推論時――で保護が止まってしまいます。ホストにアクセスできる者なら誰でも、その知的財産を持ち去れてしまいます。モデル所有者にとっての核心的な課題は、モデルIPを完全に保護しながら、収益成長を加速するためにフロンティアAIをオンプレミスでどのようにデプロイするか、という点です。

ハードウェアベースの証明で知的財産(IP)を保護

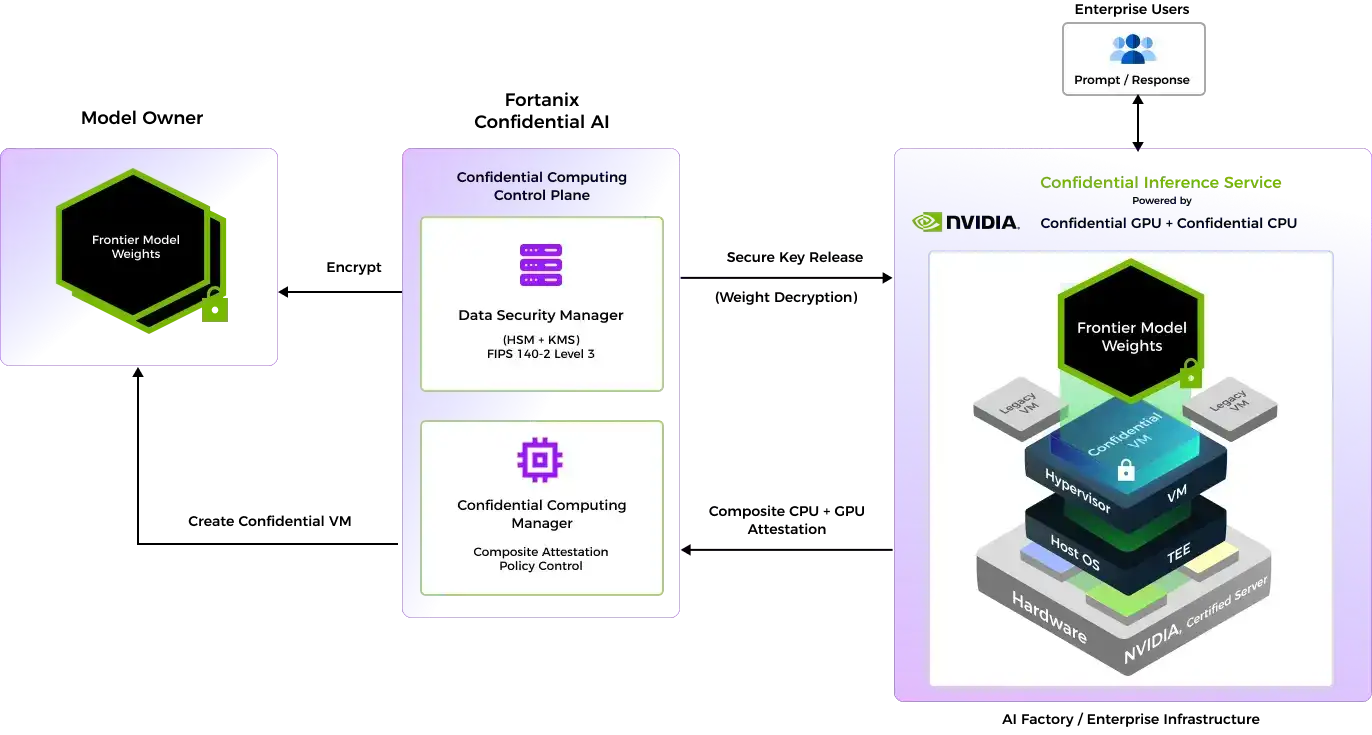

Fortanix Confidential AIは、FortanixとNVIDIAの共同ソリューションで、機密コンピューティング技術を活用し、ハードウェアで強制された信頼実行環境(TEE)内でAIモデルをオンプレミスに展開します。ローカル展開により応答時間が短縮される一方、TEE内でAIのIPを実行することで、モデルの重みが基盤となるインフラ、OS、特権管理者から保護されます。GPUとCPUにまたがる組み込みの複合暗号学的アテステーションにより、正確なハードウェアおよびソフトウェア環境が検証され、エンクレーブが本物で改ざんされていないことを確認します。そのうえでのみ、モデルはTEE内で安全に復号され、安全に実行できる状態になります。検証済みアテステーションからほんのわずかでも逸脱があれば、暗号鍵は失効し、AIワークロードは停止されます。

福利厚生

新たな収益源を開拓する

規制市場の解放、ソブリンAIイニシアチブの支援、そして低遅延のリアルタイム性能の実現

露出させずに導入規模を拡大

暗号化され、アテステーション済みのCVMイメージ内にモデルの重みを一度だけパッケージ化し、任意の数の企業へデプロイできます

コンプライアンスで信頼を獲得する

エンドツーエンドのAIワークロード保護について、検証・監査可能な証拠を提示します

仕組み

暗号化とパッケージ化

モデルの重み、コード、構成は、Fortanix DSM(Data Security Manager)に保管されたエクスポート不能キーで暗号化されています。Fortanix DSMはFIPS 140-2 レベル3に準拠したハードウェアセキュリティモジュールで、オンプレミスおよびSaaSとして利用可能です。暗号化されたモデルは配布用にConfidential VMイメージにパッケージ化されます。

複合アテステーション

Fortanix CCM(Confidential Computing Manager)はTEEを管理し、アテステーションポリシーを適用し、正確なハードウェア(CPU + GPU)とソフトウェア環境を検証して、証明書を発行する前にエンクレーブが本物で改ざんされていないことを確認します。

セキュアキーリリース

両方の認証チェックを通過してはじめて、暗号鍵が検証済みのTEEにのみ解放されます。フロンティアモデルはエンクレーブ内で復号され、実行されます。管理者、クラウドオペレーター、特権を持つ内部者であっても、重み(ウェイト)にはアクセスできません。

対応ハードウェア

- GPU:NVIDIA Hopper、Blackwell Confidential Computing

- CPU:Intel TDX、AMD SEV-SNP

- デプロイ先:オンプレミス、ソブリンAIファクトリー、パブリッククラウド